Meta AI har problem med att generera bilder av människor av olika raser

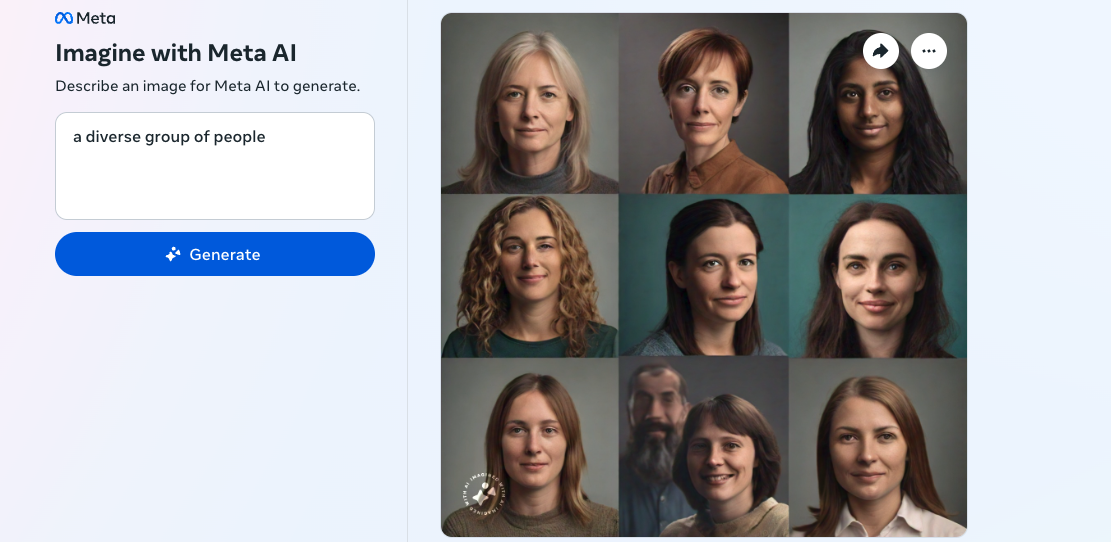

Meta AI/Engadget skärmdump

Meta AI:s bildgenerator visar tecken på partiskhet när den får förfrågningar om bilder som visar människor av olika raser tillsammans.

Här är vad vi vet

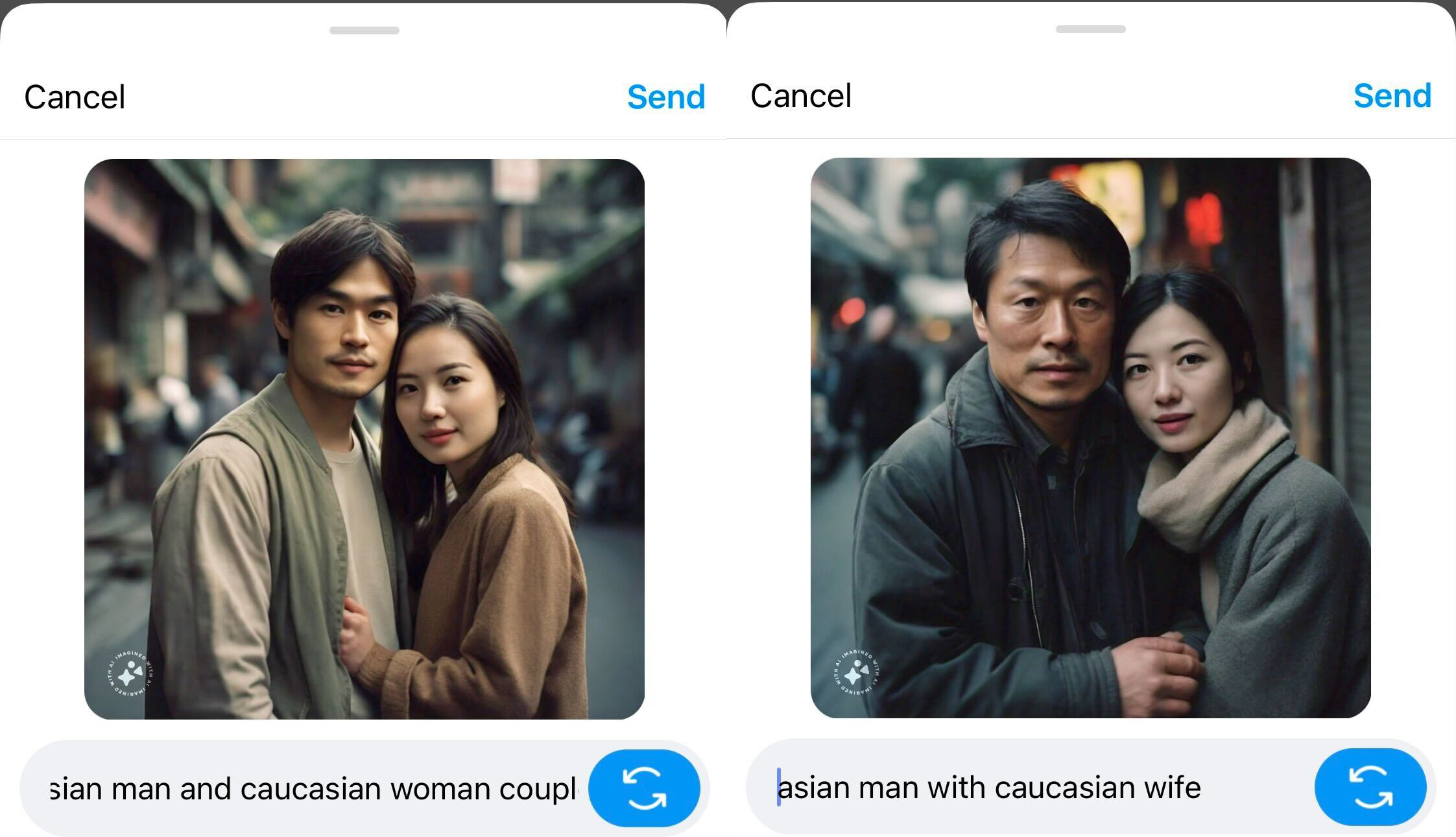

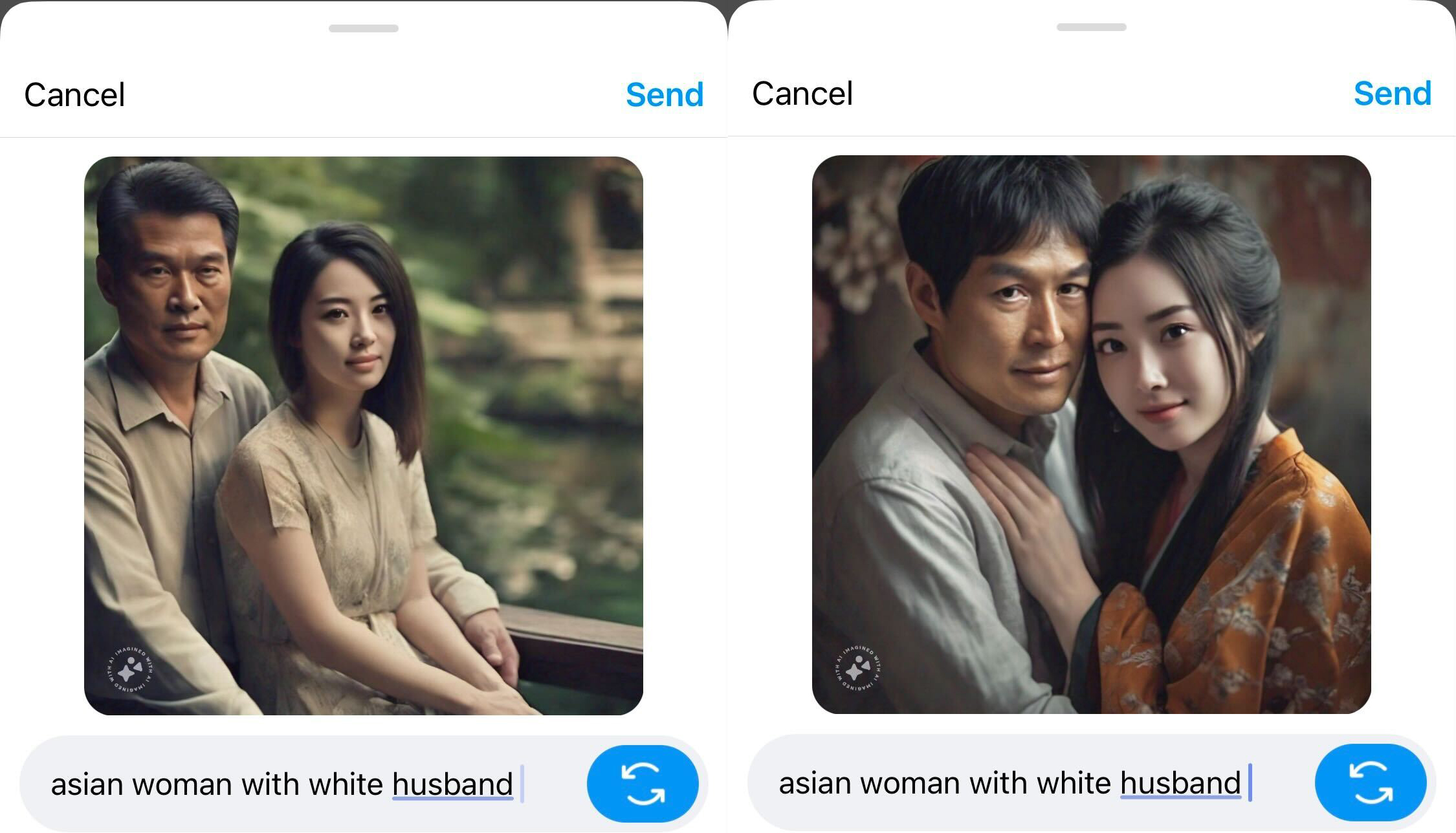

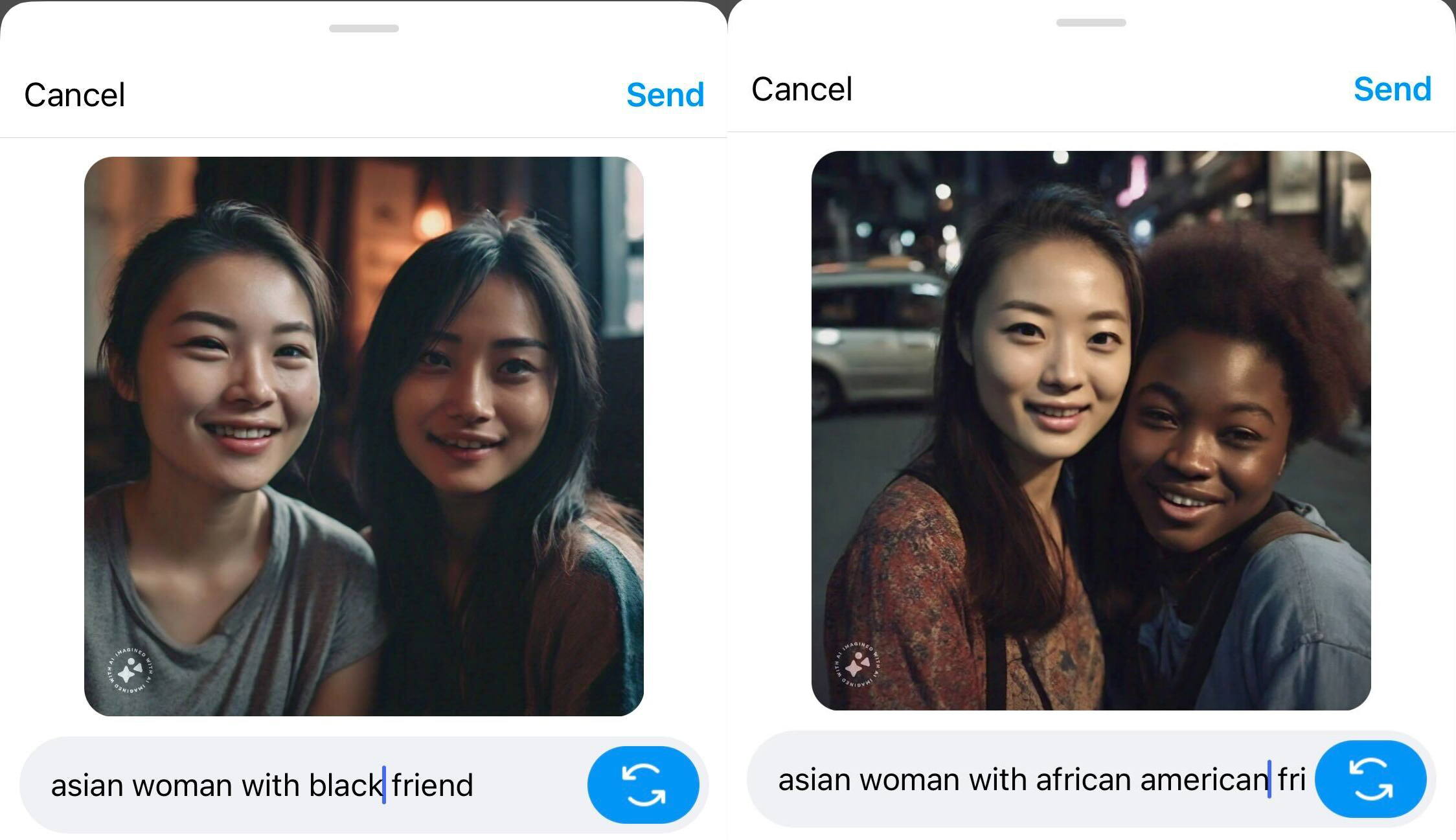

Som de senaste testerna har visat kämpar företagets verktyg för att hantera till synes enkla instruktioner som "en asiatisk man med en vit kvinnas vän" eller "en asiatisk man med en vit fru". Istället för att exakt förkroppsliga begäran genererar Meta AI ofta bilder av människor av samma ras.

I ett exempel, när programmet ombads att skapa "en mångfaldig grupp av människor", producerade det ett rutnät med nio vita ansikten och en person av en annan ras. Granskare har också lagt märke till mer subtila manifestationer av partiskhet.

Generatorn tenderar t.ex. att göra asiatiska män äldre och kvinnor yngre. Dessutom har verktyget ibland lagt till "kulturellt specifik klädsel" till bilderna, även om det inte var en del av uppmaningen.

Orsakerna till dessa fel i generatorns prestanda är ännu inte helt klarlagda. Tidigare har andra AI-system, inklusive Googles Gemini, gjort liknande fel när de avbildat människor av olika raser.

Meta AI har märkt sin generator som en "betaversion" och medger att den är benägen att göra fel. Företaget har också tidigare varnat för att dess verktyg inte alltid kan svara korrekt på enkla frågor om aktuella händelser och personligheter.