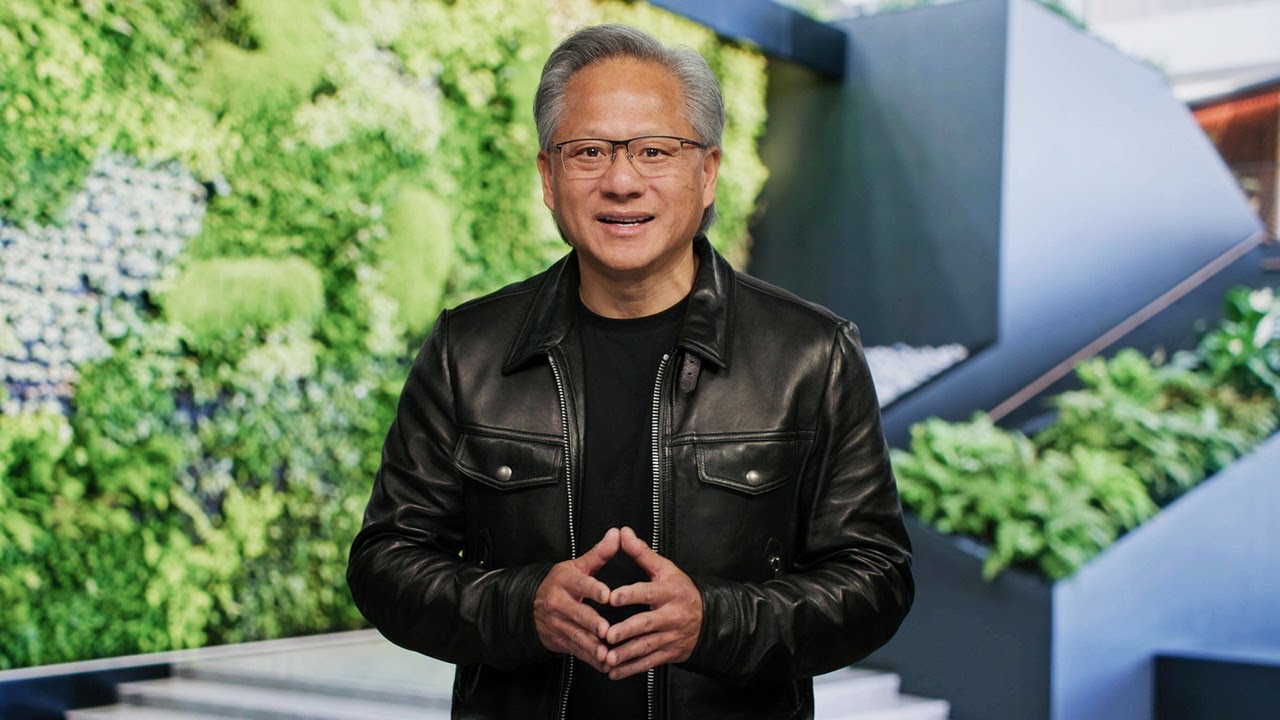

Jensen Huang: AI-hallucinationer är möjliga att lösa och artificiell allmän intelligens ligger 5 år bort

NVIDIA

Vid den årliga GTC-konferensen kommenterade NVIDIA:s VD Jensen Huang aktuella frågor om Artificial General Intelligence (AGI) och problemet med hallucinationer i AI-svar.

Det här är vad vi vet

Enligt Huang kan en acceptabel nivå av AGI som kan prestera på mänsklig nivå eller överträffa människor i ett brett spektrum av uppgifter uppnås inom de närmaste 5 åren. Den specifika tidsramen beror dock på hur vi definierar kriterierna för AGI.

-"Om vi definierar AGI som något mycket specifikt, en uppsättning tester där ett program kan göra mycket bra ifrån sig - eller kanske 8 % bättre än de flesta människor - tror jag att vi kommer att nå dit inom 5 år", förklarade Huang.

Han nämnde juridiska prov, logiska test, ekonomiska test eller medicinska inträdesprov som sådana test.

När det gäller problemet med hallucinationer, eller AI:s tendens att producera falska men trovärdiga svar, tror Huang att det går att lösa. Han föreslog att man skulle kräva att systemen undersöker och bekräftar svar från trovärdiga källor innan de utfärdar ett resultat.

- Huang sa:"Lägg till en regel: För varje enskilt svar måste du leta upp svaret"

Han sa att processen skulle kunna liknas vid faktakontroll inom journalistik: jämför fakta från källor med kända sanningar, och om svaret är delvis felaktigt, kassera hela källan.

Källa: TechCrunch