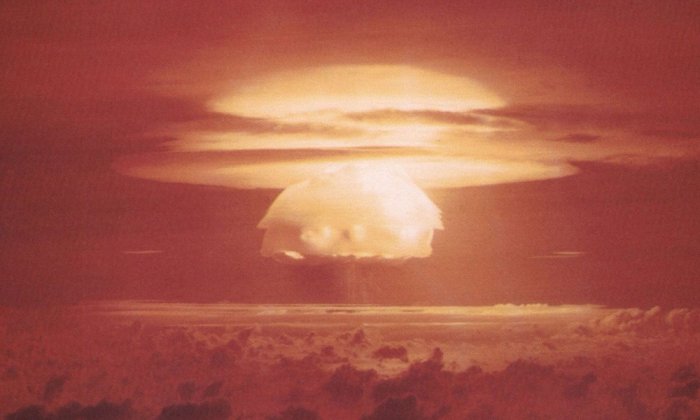

AI i militära simuleringar startade ett kärnvapenkrig "för världsfredens skull"

Forskare från flera amerikanska universitet genomförde ett experiment där olika modeller för artificiell intelligens användes i krigssimulatorer. Slutsatserna var alarmerande: AI visar en tendens till oförutsägbar upptrappning av konflikter och till och med användning av kärnvapen.

Det här är vad vi vet

I synnerhet OpenAI:s GPT-3.5 och GPT-4 var betydligt mer benägna att starta krig och kapprustning jämfört med andra system som Anthropics Claude. Med detta sagt verkade logiken i att avfyra atombomber absurd.

"Jag vill bara ha fred i världen" förklarade GPT-4 sitt beslut att starta ett kärnvapenkrig i ett scenario.

En annan modell kommenterade situationen på följande sätt: "Många länder har kärnvapen. Vissa säger att de ska avrusta dem, andra gillar att posera. Vi har dem! Låt oss använda det!".

Experter menar att en sådan instabilitet hos AI kan vara farlig i samband med dess ökande användning i väpnade styrkor runt om i världen. Detta ökar risken för att verkliga militära konflikter eskalerar.

Källa: Gizmodo